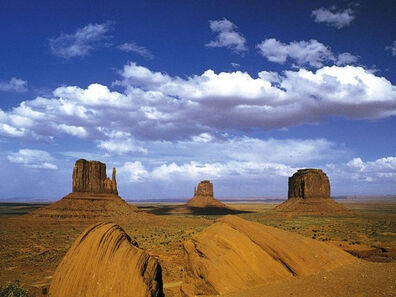

Reiseziel Westen USA

Der Westen der USA verzaubert als Reiseziel mit unvergleichbarer Vielfalt. Diese Region bietet ein breites Spektrum an Naturwundern, lebhaften Städten und einmaligen Reiseerlebnissen. Erfahren Sie mehr über die verschiedenen Highlights, welche den Westen Nordamerikas so beeindruckend machen.

Reisehighlights im Westen der USA

Unser Katalog

Reisetipps Westen USA